static.tengrinews.kz

Брэд Питт сізді алдап жүр ме? Жасанды интеллект алаяқтарынан қорғанудың жолдары

Көз алдыңыздағы көрініске немесе құлағыңыздағы дыбысқа сену қиынға соғатын заман келді. 2026 жылға қарай жасанды интеллект (ЖИ) арқылы жасалған жалған бейнелер мен дауыстар алаяқтардың ең қауіпті құралына айналды. Бұрын тек Голливуд студияларына ғана қолжетімді болған технологиялар енді кез келген адамның қолында.

Бұл туралы Infohub.kz ақпарат агенттігі хабарлайды.

Дипфейктер қалай пайда болды?

Бастапқыда әлеуметтік желілердегі көңілді фильтрлер мен фильмдердегі кейіпкерлерді «жасарту» үшін қолданылған технологиялар бүгінде әрбір смартфонға енді. Енді шынайы бейне мен компьютерлік кодтың аражігі жойылып, экрандағыға сену қауіпті болып тұр.

Алғашқы «қоңырау» әлеуметтік желілердегі танымал тұлғалардың қазақша сөйлеп, жергілікті көрікті жерлерге махаббатын білдірген вирустық бейнелер болды. Бірақ бұл көңілді видеолардың артында алаяқтардың қалтасын қағуға арналған құрал ретінде пайдаланған дипфейктердің қара нарығы қалыптасты.

Анықтама: Дипфейк – жасанды интеллект арқылы жасалған шынайы фото, видео немесе аудио жазбалардың жалған нұсқаларын жасау технологиясы. Атауы ағылшын тіліндегі «deep learning» (тереңдетілген оқыту) және «fake» (жалған) сөздерінің бірігуінен шыққан.

Көп ұзамай қазақстандық «жұлдыздар» да видеода «табысты арттырудың фантастикалық жолдары» туралы айта бастады. Кейін технологиялар осыншалықты арзандап, қарапайым қазақстандықтарға арналған жеке дипфейктерді жасау мүмкін болды. Мысалы, Қостанай тұрғынына «Киану Ривздің өзі» болып хабарласқан жағдай.

2026 жылғы ЖИ алаяқтығының жұмыс істеу әдістері

Арнайы алгоритм (нейрожелі) белгілі бір адамның нақты суреттерін, бейнелерін немесе дауыс жазбаларын зерттейді. Ол бет-әлпеттің қимылы, көздің қысылуы, дыбыстың айтылу интонациясы сияқты барлық ерекшеліктерді «есте сақтайды». Содан кейін нейрожелі бір адамның бетін немесе дауысын екіншісінің әрекеттеріне «салады».

2026 жылы дипфейктер үш негізгі түрге бөлінеді:

Басты қауіп неде?

Бұрын мұндай эффектіні жасау үшін кәсіби киностудияның апталар бойы жұмыс істеуі қажет болатын. Ал бүгінде бірнеше долларлық қосымша арқылы смартфонмен «цифрлық егізді» 30 минутта жасауға болады. Дипфейктер дәуірінде «көзбен көрдім» деген сөз енді шындықтың кепілі бола алмайды.

25 миллион долларлық тонау – ең «қымбат» жағдай

Осы уақытқа дейінгі ең ауқымды және техникалық жағынан жетілдірілген шабуыл 2024 жылы Гонконгте болды. Бұл жағдай қаржы қызметкерінің қорқынышты түсі сияқты көрінгенімен, шын мәнінде орын алған.

Шабуылға ұшыраған компания – британдық Arup Group компаниясының Гонконг филиалы. Бұл компания Сидней опера театры мен Париждегі Помпиду орталығы сияқты әлемге әйгілі жобалармен жұмыс істеген.

Қаржы бөлімінің қызметкері Лондоннан келген «қаржы директорынан» құпия транзакция жасау туралы хат алады. Сома үлкен болғандықтан, менеджер күмәндана бастайды, бірақ алаяқтар оны «растау үшін» Zoom арқылы топтық бейне қоңырауына шақырады.

Қоңырау нақты уақытта өтеді, экранда қызметкер өзі танитын директорды және бірнеше әріптестерін көреді. Осы бейне кеңес беру арқылы сенімденген қызметкер бес түрлі шотқа 25 миллион доллар аударады. Кейін белгілі болғандай, қоңыраудағы барлық қатысушылар, одан басқасы, нақты уақыттағы дипфейктер болып шығады.

Қиянатқа ұшыраған адам кейін куәлік бергенде, өзінің жалған әріптестері «нақты адамдар сияқты көрініп, сөйлегенін» айтқан.

Бұл жағдай қазіргі заманда дипфейктің құрбаны тек «сенгіш әже» емес, тіпті жоғары технологиялық халықаралық корпорацияның қызметкері де бола алатынын көрсетеді.

Қазақстандағы дипфейк алаяқтығының мысалдары

Гонконгтегі тонау туралы әңгімеден кейін бұл «әлемдік корпорациялардың өмірінен алынған сюжеттер» сияқты көрінсе, сізді ренжітуі мүмкін ақпарат бар: алаяқтық ЖИ-нің шындығы қазақстандық қалаларда бұрыннан бар. Олардың нысанасы – қарапайым азаматтар: WhatsApp-та «тірілген» кумирлермен кездеседі, «Ішкі істер министрлігінің министрлерінен» бейне хабарламалар алады және Қостанайдағы үйінен шықпай-ақ, Голливуд жұлдыздарымен «кездесулерге барады».

Димаш Құдайбергенмен жасалған жалған инвестициялық платформа

Қазақстандық интернеттің ЖИ шабуылдарының ең ауқымдыларының бірі – «Қазатомөнеркәсіп» компаниясы атынан жасалған «ірі инвестициялық жобаның» жалған жарнамалық науқаны болды. Алаяқтар ұлттық кумирді, яғни Димаш Құдайбергенді «бетке» алып, ең қасиетті нәрсеге шабуыл жасауды ұйғарды.

Ролик бірнеше миллион қаралым жинап, қазақстандықтарға уран өндіруден керемет табыс уәде етті. Бірақ ең арам ойлы қадам – жарнамада тек әншінің өзін ғана емес, оның ата-анасын да пайдалану болды.

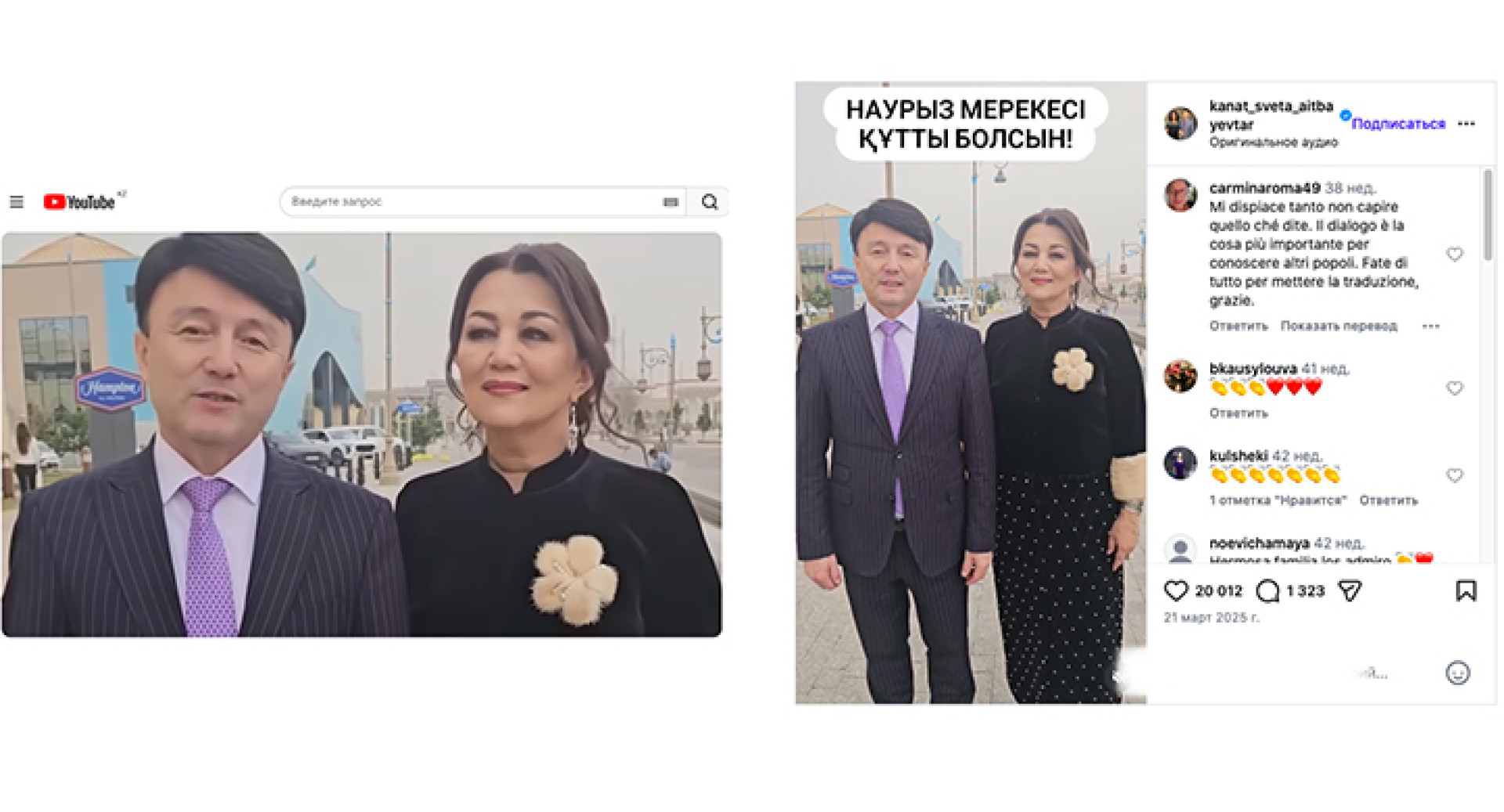

_Жалған бейнеден үзінділер (сол жақта – Димаш Құдайберген, оң жақта – оның ата-анасы)_

Димаш пен оның ата-анасымен жасалған жалған бейненің қалай жасалғаны

Дипфейк жасау үшін қылмыскерлерге ештеңе түсірудің қажеті болмады. Олар бар контентті «қайта орналастыру» әдісін қолданды. Роликтің бірінші бөлігі үшін Димаштың Instagram аккаунтынан алынған жаңа жылдық құттықтау бейнесі пайдаланылды:

Димаштың ата-анасы жоба туралы «айтатын» бөлігіне арналған материалды алаяқтар Instagram-дағы жазбадан да көшіріп алған. Түпнұсқа бейне Құдайберген отбасының наурыз мерекесімен қазақстандықтарды жылы лебізбен құттықтауы ретінде жазылған.

_Салыстыру үшін үзінділер: сол жақта – жалған бейнеден кадр, оң жақта – Құдайберген жұбының Instagram-дағы нақты жазбасынан скриншот_

Нейрожелілер арқылы алаяқтар бейнеге жаңа дыбыс салып, ерін қимылын синхрондады (липсинк) – жылы тілектер ақша салуға шақыруға айналды.

Анықтама: Липсинк (ағылш. lip-syncing – «ерін синхрондауы») – бұл бейнедегі адамның ерін қимылын алдын ала жазылған немесе генерацияланған сөйлеуге сәйкестендіру технологиясы. Нейрожелілер арқылы липсинк адамды кез келген сөзді айтуға «мәжбүр етуге» мүмкіндік береді, тіпті түпнұсқада ол мұны айтпаса да. Бұл жалған бейнелерді ерекше сенімді етеді, өйткені сөйлеу мен мимика табиғи және синхронды көрінеді.

Бұл жағдай кез келген адамның жеке контентінің ұрланып, қылмыс жасау үшін жасанды интеллектпен қайта өңделуінің хрестоматиялық мысалы болды.

«Киану Ривзге көмектескісі келді»: қазақстандықты «Голливуд жұлдызы» алдамақ болды

Димаштан қазақстандықтарға «байып кету» идеясын сатса, келесі жағдайда алаяқтар кумирмен жақындық туралы арманды сатты. 2024 жылы Қостанайдың 62 жастағы тұрғыны классикалық романтикалық алаяқтық схемасына тап болды. Барлығы оның әлеуметтік желідегі жазбасына «Киану Ривздің профиліне» толықтай ұқсайтын аккаунттан лайк қоюдан басталды.

«Актер» хат алмасып, сыпайы болды, тіпті әйелді оқиғаның шынайылығына сендіру үшін «төліқұжатының» суретін және бейне хабарламаларын (дипфейк технологиялары немесе монтаж арқылы жасалған болуы мүмкін) жіберді.

Біраз уақыттан кейін «Киану» ауыр проблемалар туралы хабарлады: сот процестеріне байланысты оның шоттары бұғатталған, ал оған медициналық шығындарға ақша қажет екен. Әйел, шынымен көмектескісі келіп, үлкен соманы аударуға дайын болды.

Бұл тек банк қызметкерлерінің мұқияттылығының арқасында болмады: олар Қостанай тұрғыны ақша аудармақ болған шоттың бейтаныс ойын компаниясына тиесілі екенін байқап, полицияға хабарлады.

Бұл жағдай ерекшелік емес, жаһандық тренд. Еуропадағы «Брэд Питтпен» болған осындай жағдай [әлдеқайда трагедиялы аяқталды](https://tengrinews.kz/curious/stalo-jenschinoy-brosivshey-muja-millionera-radi-breda-pitta-559942/): 53 жастағы французы әйел алаяқтарға 830 000 еуро аударып қана қоймай, алгоритмдер жасаған елес үшін нақты отбасын бұзды.

Цифрлық клон: алаяқтар Tengrinews.kz брендін қалай «ұрлады»

Біздің басылым да киберқылмыс схемаларының орталығында болды. Алаяқтар түсінді: адамдар бейтаныс сілтемелерге сенбейді, бірақ күнделікті лентада көретін логотипке сөзсіз сенеді.

Сондықтан олар Tengrinews.kz ресми парақшаларына визуалды түрде ұқсас жарнамалық аккаунттар жасай бастады. Олар барлығын қолданды: фирмалық түстер, шрифттер, логотип, тіпті біздің басылымның нақты журналистерінің фотолары мен есімдері.

Содан кейін олар «сыйлықтар ұтысы», «әлеуметтік төлемдер» немесе «ҚҚС өтемақылары» туралы мақсатты жарнаманы іске қосты. Сенімділік әсерін күшейту үшін қылмыскерлер танымал жаңалықтар жүргізушілерінің ЖИ көшірмелері «ресми түрде» төлемдердің басталғанын жариялаған дипфейк бейнелерді қолданды.

_Алаяқтардың сайтының скриншоты, Tengrinews.kz-ті имитациялаған_

Сілтемені басу арқылы банк немесе мемлекеттік орган парақшасы сияқты көрінетін егіз сайтқа өтесіз. Нәтижесі болжамды: онда пайдаланушыдан ЖСН, карта нөмірін және – назар аударыңыз – CVV кодын енгізу сұралады. Осы сәттен бастап шотты бақылау қылмыскерлерге өтеді.

Еліміздің ең ірі ақпараттық порталының брендін пайдалану – аудиторияның психологиялық қорғанысын «бұзу» әрекеті екенін түсіну маңызды. Егер жаңалық Tengrinews-тен келген пост сияқты көрінсе, көптеген адамдардың сыни ойлауы өшеді.

Жалған басылымдардың құрығына қалай ілінбеуге болады?

Бір кезде біздің редакция оқырмандар үшін арнайы ескерту шығаруға мәжбүр болды:

[Әлеуметтік желілердегі алаяқтық: Tengrinews.kz жалған жазбалар туралы ескертеді](https://tengrinews.kz/kazakhstan_news/moshennichestvo-sotssetyah-tengrinewskz-preduprejdaet-546969/)

Есте сақтау керек: цифрлық әлемде сайттың таныс «бас жағына» да сенуге болмайды. Әрқашан екі параметрді тексеру қажет:

Қазақстандағы киберқылмыс статистикасы. ҚР ІІМ және Бас прокуратураның Құқықтық статистика комитеті ұсынған деректерге сәйкес, интернет-алаяқтық азаматтардың қауіпсіздігіне басты қатерлердің бірі болып қалуда. 2025 жылы Қазақстандағы киберқылмыстардан келген жалпы залал сомасы 16,4 миллиард теңгеге жетті. Бұл соңғы бірнеше жылдағы абсолютті рекорд. Сотқа дейінгі тергеудің бірыңғай тізілімінде интернет-алаяқтыққа (ҚР ҚК 190-бабы, 2-бөлігі, 4-тармағы) қатысты шамамен 20 мың қылмыстық іс тіркелген. Бұл елдегі алаяқтық жағдайларының жартысына жуығы (48 пайызы). Киберқылмыстар саны бойынша Алматы (барлық жағдайлардың шамамен 40 пайызы), Астана және Шымкент көш бастап тұр.

Іштен көрініс: цифрлық елестер қалай жасалады және неге біз оларға сенеміз?

«Киану Ривз» туралы әңгімелер немесе Гонконгтегі миллиондаған қаржы ұрлығының негізінде – адам психологиясын білумен көбейтілген алгоритмдердің жұмысы жатыр.

Нейрожелілердің біздің күнделікті өмірімізге қаншалықты терең енгенін және шындықты генерациядан ажыратуға мүмкіндігіміз бар-жоғын түсіну үшін біз бұл саланы ішінен кәсіби деңгейде білетіндерге жүгіндік.

Біздің сарапшыларымыз – ЖИ суретшілерінен бастап компьютерлік криминалистерге дейін – қазіргі дипфейктердің қалай жасалатынын, неге алаяқтар кәсіби психологтарға айналғанын және «өз көздеріңіз алдағанда» не істеу керектігін түсіндіреді.

«Жақын арада тіпті мамандар да нейрондардың жұмысын шынайылықтан ажырата алмайды»

Риз Есентаев – нейросуретші, нейрожелілер арқылы суреттер мен бейнелер жасаумен айналысады. Ол қазіргі дипфейктерді жасау құралдарының ЖИ өндірісінде кеңінен қолданылатынын атап өтеді және басқаның келбетін пайдаланудың бірнеше түрлі тәсілі бар екенін айтады:

«Ал алаяқтық әрекеттер туралы айтатын болсақ – мұнда қылмыскерлер үшін мүмкіндіктер өрісі өте үлкен».

— Мамандар қазіргі уақытта дипфейкті 100% сенімділікпен анықтай ала ма? – деп нақтылаймыз нейросуретші Есентаевтан.

— Қолданылатын технологияға байланысты. Иә, айырмашылықты тіпті маманның өзі де көру қиын болатын технологиялар бар, – деп жауап береді ол. – Ал ИЖИ-технологиялардың даму қарқынымен жақын арада мамандар үшін нейрожелінің жұмысын және нақты түсірілімдерді ажырату мүмкін болмай қалады.

— Қарапайым адам, маман емес, жалған бейнені қалай ажырата алады?

— Беттің айналасындағы артефактілерге мұқият қарау керек: бұл анық емес жиектер, бет пен дене қалдығының әртүрлі текстурасы мен анықтығы; анимациядағы проблемалар, табиғи емес қозғалыстар, және ең бастысы – бұл липсинк, яғни еріннің қозғалысы.

Көбінесе нейрожеліні еріндерінен анықтауға болады, өйткені сөйлеу кезінде бұл өте белсенді қозғалыстар және олар әрқашан дыбыспен тамаша синхрондалмайды.

— Бұл технологияның екі жағы бар, – деп атап өтеді сарапшы. – Бір жағынан – үлкен тәуекелдер: алаяқтық, жалған жаңалықтар, саяси манипуляциялар. Қазірдің өзінде президент немесе танымал блогер не айтса да, 90% адамдар бұған сенетін бейне жасауға болады.

Екінші жағынан, бұл керемет шығармашылық құрал. Біз өндірісте бұрын айлап түсіріліп, миллиондаған шығынға ұшыраған жұмыстарды енді бірнеше күнде жасаймыз. Актерді «жасартуға», шын мәнінде жоқ кейіпкерді жасауға немесе бренд-амбассадордың жүзімен жарнама түсіруге болады, тіпті ол физикалық түрде басқа құрлықта болса да.

Сондықтан менің ойымша, технологияны тыйым салу немесе қатты шектеу – бос әурешілік, ол бәрібір дами береді. Бейненің жүз пайыздық дәлел болмайтын әлемде өмір сүруді үйрену маңыздырақ.

«Майкл Джексон» Tengrinews оқырмандарына жүгінеді

Технологияның қаншалықты алға кеткенін түсінудің ең жақсы жолы – оны іс жүзінде көру. Қазіргі уақытта «поп-музыка королі Майкл Джексон» төмендегі екі бейнеде Tengrinews.kz оқырмандарына мақалаға сәйкес келетін үндеу тастайды:

Бұл ролик – біздің редакциямыз үшін арнайы нейросуретші Риз Есентаев жасаған 100% дипфейк.

Бұл қалай жасалды?«Мұндай роликті жасау төрт кезеңнен тұрады: суретті генерациялау, анимация, дыбысты генерациялау және липсинк. Барлығы шамамен 30-40 минутты алды», – дейді сарапшы.

[TikTok жұлдызы өзінің «бетін» миллиард долларға жуық сатты](https://tengrinews.kz/curious/zvezda-tiktok-prodala-svo-litso-za-1-milliard-dollarov-591075/)

Еліктеу фабрикасы: интернеттің жартысы боттардан тұрады

Алаяқтардың алдауды қалай автоматтандыратынын және пікір таласындағы сұхбаттасыңыздың бағдарламалық код жолы болуы мүмкін екенін түсіну үшін біз өзін бот жасаушы деп атайтын сарапшы Елхан Оралбаевқа жүгіндік.

Елхан клиенттермен қарым-қатынас жасау және рутинды процестерді автоматтандыру үшін әлеуметтік желілер мен мессенджерлерде «өмір сүретін» боттар жасайды.

Ол біз қазірдің өзінде «өлі интернетте» өмір сүріп жатқанымызға, онда тірі реакцияны генерацияланғаннан ажырату мүмкін емес екеніне сенімді.

— Елхан, рас па, әлеуметтік желілердегі кез келген жазбаның астында боттардың жаппай шабуылы болуы мүмкін бе, және біз кейде адамдардың емес, жасанды интеллекттің жауаптарын оқимыз ба?

— Бірден айтайын. Әртүрлі деректер бойынша, бүгінде интернеттегі пікірлердің 50 пайызы, тіпті одан да көбі – боттардан. Қазіргі ЖИ-бот берілген триггерлер бойынша ақпаратты өзі іздей алады, контексті талдайды және оған жазылған промтке (тапсырмаға) сәйкес жазбаға пікір қалдырады. Бұл 24/7 автоматты режимде жүреді. Боттар шаршамайды, ұйықтамайды және кез келген эмоцияны – таңданыстан ашулы пікірталасқа дейін имитациялай алады.

— Қазіргі уақытта қарапайым пайдаланушылар үшін ЖИ қолданудың қандай сценарийлері ең қауіпті?

— Бастысы – классикалық схемалардың эволюциясы. Бұрын алаяқтар «інім апатқа ұшырады» деп дауысын бұзып қоңырау шалса, енді олар сіздің жақыныңыздың нақты дауысын қолданады. ИЖИ тіпті Telegram-дағы қажетті тұлғаның бейнесі бар қысқа бейне жаза алады.

Спуфинг технологиясымен (нөмірді жасыру) біріктірілгенде, сіздің телефоныңыздың экранында сіздің телефон кітабыңыздан нақты контакт пайда болғанда, мұндай шабуыл өлімге әкелуі мүмкін. Бірақ мұнда қарапайым қорғаныс бар: егер сізге ұялы байланыс арқылы туыс атынан қоңырау шалса, дереу қойып, өзіңіз қайта қоңырау шалыңыз. Тек кері қоңырау шалғанда ғана сіз нақты адамға, ал алаяқтар серверіне емес, сенімді түрде қосыласыз.

— Біз «хакерлік» күрделі техникалық процесс деп үйреніп қалдық. ИЖИ хакерлердің өмірін жеңілдетті ме?

— ИЖИ зиянды бағдарламалық жасақтаманы адамнан әлдеқайда жылдам жасайды, бірақ адамды «бұзу» жүйені бұзудан әлі де оңай. Қазір достардың бұзылған аккаунттары арқылы фишинг гүлденіп жатыр. Сізге жеке хабарламамен сілтеме келеді: «фотоға дауыс бер», «менің бейнемді көр». Сылтаулар кез келген болуы мүмкін.

Сарапшының ұсынысы: егер сілтеме танымал қызметтерге (YouTube, Instagram, TikTok) апармаса, бірақ қандай да бір авторизацияны немесе дауыс беруді талап етсе – кірмеңіз. Басқа мессенджер арқылы жіберушімен байланысыңыз. Ақша сұрау туралы кез келген кездегі өтініштерге де сол сияқты қараңыз.

— Ақпараттық хабарламалар мен сайттарды жасау үшін алаяқтар нейрожелілерді қолдана бастады дейді. ИЖИ-фишинг ескісінен несімен ерекшеленеді? Қазір грамматикалық қателер болмағанда, жалғандықты не көрсетеді?

— Иә, визуалды түрде фишинг құралдары прототиптерден ажыратылмайтын болды. Бірақ оларды анықтау белгілері, таңқаларлықтай, сол қалпында қалды: бір немесе екі символ қатесі бар ұқсас домендік атаулар, ақпараттағы сәйкессіздіктер (өзекті емес мекенжай, жұмыс орны), тым жалпы формулировка. Шабуылдың логикасы да ескі қалпында қалды – растаудың уақыт аралығы қысқа. Және психология – «бұғаттау», «бонус есептелді», «уақыт шектеулі». Сонымен қатар, классика – онлайн-форма арқылы сұрау, бұл деректер белгілі болуы немесе бұл сұрау үшін артық болуы керек: ЖСН, CVV коды бар банк картасының деректемелері және т.б.

— Сіз басқарған, ИЖИ ең күтпеген жерде қолданылған іс туралы айтып беріңіз.

— Көбірек кеңесші болдым. Танысу сайтындағы қыздың цифрлық тұлғасы. Ұзақ хат алмасу. Фото. Видео. Нәтижесінде – болжамды нәтижемен қаржылық көмек сұрау.

— Қылмыс болған жерде, ол цифрлық болғанда не болады? Компьютерлік криминалисттің «шығуы» қалай көрінеді?

— Барлығы сипат пен жағдайларға байланысты. Қандай жағдайда да, классикалық криминалистика сияқты – қылмыс «орнын» (телефон, компьютер, сервер) қарау, дәлелдерді (логтар, файлдар, жад дампы) жинау. Кейде және көбінесе бұл қашықтан жүзеге асырылады. Сирек – жабдық орналасқан жерге немесе тіпті алаяқтар колл-орталығына барып, цифрлық іздерді жою әрекеттерін тоқтату. Бірақ кейде ерекшеліктер де болады: мысалы, өмірлік көрсеткіштердің динамикасы бойынша өлімнің нақты уақыты мен оның мән-жайларын анықтау мақсатында фитнес-білезіктен деректерді зерттеу және жинау.

«Ақымақтар арасында құрбандар жоқ»

Біз дипфейктердің қалай жасалатынын және боттардың біздің кеңістігімізді қалай толтыратынын көрдік. Бірақ басты сұрақ: **бұл технологиялардың бар екенін біле тұра, неге біз әлі де олардың құрығына ілініп жатырмыз?**

Киберқылмыстың «анатомиясын» түсіну және қазіргі «цифрлық ұры» қалай көрінетінін білу үшін біз компьютерлік криминалистика саласындағы сарапшы, форензик Анатолий Ремнёвпен сөйлестік.

Анықтама: Форензик (forensic) – бұл қаржылық алаяқтықтарды, корпоративтік алаяқтықтарды және киберқылмыстарды тергеу, бизнес қорғау және сотқа дәлелдер дайындау, соның ішінде қаржылық тергеулер, цифрлық деректерді талдау (компьютерлік форензика), контрагенттерді тексеру және сыбайлас жемқорлықты анықтау бойынша шаралар кешені немесе маман.

Оның жұмысы – қылмыскер өзін көрінбейтіндей көрсетуге тырысқан жерде цифрлық іздерді іздеу. Ал оның тәжірибесі өз қауіпсіздігі туралы қарым-қатынасты қайта қарауға мәжбүр етеді.

Біздің бірінші сұрағымыз: егер 2-3 жыл бұрынғы жағдаймен салыстырсақ, Қазақстандағы орташа кибер алаяқ қалай өзгерді? Қандай жаңа құралдар пайда болды?

Маманның жауабы:

«Орташа алаяқ – бұл тым жалпы анықтама. Біз әрбір алаяқтық схемасының артында тек соңғы орындаушылар ғана емес, ұйымдастырушылар да тұратынын түсінуіміз керек. Дәл олар пайдаланушы психологиясы, интернеттің қарапайым адамы саласында, алдау әдістерінде әлдеқайда тәжірибелі болды. Алаяқтықтың мәні өзгерген жоқ. Оның форматы өзгерді. Біздің қоғамымыз цифрлық болды. Барлық жағымсыз және деструктивті құбылыстар біздің күнделікті өмірімізден цифрлық экожүйеге біркелкі және үйлесімді, қаншалықты таңқаларлық естілсе де, ауысты.Құралдар туралы айтатын болсақ – бұл әлі де сол төрт негізгі әлеуметтік инженерия әдісі:

Алаяқтықтың мәні мен саласына байланысты белгілі бір классикалық әдіс таңдалады және оған нақты схема бейімделеді. Мәні бір – пайдаланушының сеніміне кіріп, оны өз еркімен өз ақшасынан немесе мүлкінен айырылуға мәжбүр ету. Мәселе мынада, алаяқтар күн сайын осындай мамандандырылған салаларда, мысалы, профайлинг сияқты, өздерінің біліктілігін арттыруда.

Анықтама: Профайлинг (ағылш. profiling – «профиль жасау») – бұл адамның мінез-құлқын, сөйлеуін, эмоцияларын және сыртқы белгілерін талдау әдісі, ол оның психологиялық ерекшеліктерін анықтауға және ықтимал әрекеттерді болжауға мүмкіндік береді. Бастапқыда профайлинг криминалистикада және қауіпсіздік қызметтерінде қолданылған – мысалы, күдікті жолаушыларды анықтау немесе қылмыскердің портретін жасау үшін. Уақыт өте келе оны басқа салаларда да қолдана бастады: бизнес, келіссөздер және күнделікті қарым-қатынас. Киберқылмыс контекстінде профайлинг әлеуетті осал адамдарды таңдауға және олармен тиімді қарым-қатынас тактикасын құруға көмектеседі – мысалы, қорқынышқа, шұғылдыққа немесе сенімге қысым жасау. Сондықтан да көптеген алдау схемалары сенімді көрінеді: олар тек технологияларға ғана емес, адам психологиясын дәл түсінуге де негізделген.

— Қазақстанда қазіргі уақытта кең таралған, бірақ көптеген адамдар тіпті күдіктенбейтін ЖИ қолданылатын бір схеманы атап беріңіз.

— Өкінішке орай, таралу дәрежесі туралы нақты баға бере алмаймын, бірақ менің ойымша, бұл танымал саясаткерлердің, блогерлердің, қоғамдық тұлғалардың бейнесі мен дауысын көшіріп, жоғары кірісті салымдарды немесе жоқ акцияларды жарнамалау схемасы. Бұл әлеуметтік желілерде әртістерді, актерлерді, қоғамдық пікір көшбасшыларын тарта отырып, әртүрлі жарнамалармен қалыпты ақпараттық шудың ішінде өте табиғи көрінеді.

— Deepfake – бұл енді жай ғана бейнедегі бетті ауыстыру емес. Сіздің тәжірибеңізде синтетикалық дауыс пен бейнені қолданудың ең айлалы нұсқалары қандай болды?

— Сіздікі дұрыс, deepfake «бейнеге бет жапсыру» шеңберінен әлдеқашан шығып кеткен. Ең жетілдірілген схемалар – бұл бейне мен интерактивті реакция сценарийлерінің (мінез-құлық контексті) комбинациялары, мұнда жасанды интеллект тек сыртқы келбетті ғана емес, қарым-қатынас стилін де имитациялайды. Бұл көбінесе бейнеконференциялар арқылы жүзеге асырылады. Жеке тәжірибемде қаржылық пирамидалардың бірінің тұсаукесерінен өткізілген бейнеконференция жазбасын зерттеуге тура келді, онда компания «негізін қалаушысы» қатысушылармен сөйлесіп, олардың сұрақтарына жауап берді. Сондай-ақ, «ана, мен апатқа ұшырадым» тақырыбындағы бейнелермен танымал «кружочектер» кездесті.

— «Синтетикалық тұлғалардың» пайда болуын көріп отырмыз. Банктер ИЖИ-ді адамнан ажырату мүмкін еместігіне байланысты қашықтан тұлғаны тексеруден мүлдем бас тарта ма? Онда не болады?

— Жоқ деп ойлаймын, қашықтан тұлғаны тексеру процедурасы қалады. Бірақ айтарлықтай өзгерістерге ұшырайды. Мұндағы ең күрделі мәселе – эталон ретінде биометриялық ақпаратты (саусақ іздері, көздің тор қабығының суреттері) жинау. Мүмкін, технологиялардың дамуымен және тұлғаны растаудың техникалық факторлар жиынтығына негізделген модельдерін әзірлеумен екі факторлы тексерудің қандай да бір формасы қолданылады.

— Қазақстанда телефон қоңырауы кезінде адамның дауысын ИЖИ-ден синтезделгеннен 100% ажырата алатын бағдарламалар бар ма?

— Мен мұндай бағдарламалық жасақтаманың бар екені туралы білмеймін. Және техникалық тұрғыдан мұндай бағдарламалық жасақтама бірқатар себептерге байланысты мүмкін емес. Сөйлеуді синтездеу сапасы қазірдің өзінде «адам – адам» деңгейінде: заманауи ИЖИ-модельдері дем алуды, кідірістерді, сөз қатесін, эмоцияларды, интонацияларды имитациялайды, шуға және «телефондық» дыбыс сапасына бейімделеді. Байланыс желілерінде цифрлық сигналды өңдеу кезінде көптеген артефактілер (ИЖИ белгілері) жай ғана жойылады, ал детекторға «ілінуге» ештеңе қалмайды. Иә, жүйелер бар (көбінесе банктерде), олар спектрді, сөйлеу ырғағын талдайды, мінез-құлық белгілерін тексереді, бірақ олар көбінесе эталондық жазбалармен салыстыруға негізделген және олардың жұмысының нәтижесі ықтималды – баға пайыздарда беріледі.

«Бұл нақты дауыс па?» деген сұрақ енді дәл және сенімді жауапқа ие емес. Дұрыс сұрақ басқа: «Дауысқа сену мүмкін болмаса, тұлғаны қалай тексеруге болады?»— Алаяқтар фишингтік хаттар мен сайттар жасау үшін нейрожелілерді қолдана бастады. ИЖИ-фишинг ескісінен несімен ерекшеленеді? Қазір грамматикалық қателер болмағанда, жалғандықты не көрсетеді?

— Иә, визуалды түрде фишинг құралдары прототиптерден ажыратылмайтын болды. Бірақ оларды анықтау белгілері, таңқаларлықтай, сол қалпында қалды: бір немесе екі символ қатесі бар ұқсас домендік атаулар, ақпараттағы сәйкессіздіктер (өзекті емес мекенжай, жұмыс орны), тым жалпы формулировка. Шабуылдың логикасы да ескі қалпында қалды – растаудың уақыт аралығы қысқа. Және психология – «бұғаттау», «бонус есептелді», «уақыт шектеулі». Сонымен қатар, классика – онлайн-форма арқылы сұрау, бұл деректер белгілі болуы немесе бұл сұрау үшін артық болуы керек: ЖСН, CVV коды бар банк картасының деректемелері және т.б.

— Сіз басқарған, ИЖИ ең күтпеген жерде қолданылған іс туралы айтып беріңіз.

— Көбірек кеңесші болдым. Танысу сайтындағы қыздың цифрлық тұлғасы. Ұзақ хат алмасу. Фото. Видео. Нәтижесінде – болжамды нәтижемен қаржылық көмек сұрау.

— Қылмыс болған жерде, ол цифрлық болғанда не болады? Компьютерлік криминалисттің «шығуы» қалай көрінеді?

— Барлығы сипат пен жағдайларға байланысты. Қандай жағдайда да, классикалық криминалистика сияқты – қылмыс «орнын» (телефон, компьютер, сервер) қарау, дәлелдерді (логтар, файлдар, жад дампы) жинау. Кейде және көбінесе бұл қашықтан жүзеге асырылады. Сирек – жабдық орналасқан жерге немесе тіпті алаяқтар колл-орталығына барып, цифрлық іздерді жою әрекеттерін тоқтату. Бірақ кейде ерекшеліктер де болады: мысалы, өмірлік көрсеткіштердің динамикасы бойынша өлімнің нақты уақыты мен оның мән-жайларын анықтау мақсатында фитнес-білезіктен деректерді зерттеу және жинау.

— Көпшілігі сенімді: «Мені алдамайды, мен ақымақ емеспін». Шын мәнінде, ИЖИ қолданылатын алаяқтықтың құрбаны кім болады?

— Олай дейік: ақымақтар арасында құрбандар жоқ.

Әлсіздік сәтінде тіпті құзыретті адамдар да құрығына ілінеді, өйткені ең алдымен алаяқтар әлеуетті құрбан туралы ақпарат жинайды және оның портреті қаншалықты толық жасалса, табысқа кепілдік соншалықты жоғары.Типикалық құрбанның портреті немесе дұрысырақ айтсақ, профилі де жоқ. Мінез-құлық психологиясы мен жағдайлық манипуляцияларға негізделген қайталанатын үлгілер бар.

— Типикалық ИЖИ айтқандай _(криминалист күледі):_ елеусіздіксіз, сиқырсыз, тәжірибе емес, интеллект емес, процедураға деген әдет қорғайды.

Көңіл көтеру үшін дипфейк

Қорытындылай келе, дипфейктердің тағы бір қаупі туралы айтып өтейік, бірақ бұл оларды жасаушыларға бағытталған. Қазіргі әлемде, тіпті қылмыстық мақсатта емес, әлеуметтік желілердегі хайп үшін жасалған жалған нәрсе де сотқа дейін жеткізуі мүмкін.

Орталық Азиядағы ең резонансты жағдай – өткен жылы Бішкекте Акума лақап атымен танымал блогердің ісі болды. Қыз нейрожелі арқылы жасалған суреттерді әлеуметтік желілерде жариялады, онда ол «Қырғызстан президенті Садыр Жапаровпен» бірге бейнеленген.

Суреттердің ИЖИ арқылы жасалғаны анық болғанымен, сот оларды мемлекет басшысының ар-намысын қорлайтын және беделін түсіретін деп тапты. Блогер жалған ақпарат таратқаны үшін кінәлі деп танылып, айыппұл төледі.

Шынында да, әлеуметтік желілердегі пайдаланушылар бұл оқиғаға наразылық білдірді:

«Екінші жағынан, Трамп, Макрон, Меркель және басқаларға жасалған қанша фотошопты көрдіңіздер. Бұл дамыған елдер, бірақ мұндай нәрселер үшін олар сотталмайды және айыппұл салынбайды», – деп жазды олар.Мұндай жағдайлар қазақстандықтарға да қауіп төндіре ме, білу үшін біз танымал заңгер Сергей Уткинге жүгіндік.

— Қазақстандағы жалпы ереже (ҚР Азаматтық кодексінің 145-бабы) бойынша: кез келген адамның бейнесін пайдалану тек сол адамның немесе оның мұрагерлерінің келісімімен ғана мүмкін, – деп түсіндіреді ол.

— Келісім сұраудың қажеті жоқ болатын ерекшеліктер бар ма?

— Ерекшеліктер журналистер үшін бар, олар «Масс-медиа туралы» және «Онлайн-платформалар туралы» заңдарда жазылған. Келісім талап етілмейді, егер:

Басқалардың фотоларын пайдаланған кезде, олардың авторы және құқық иеленушісі болуы мүмкін екенін есте ұстау керек, сондықтан авторлық құқықты сақтау мәселесі – бөлек тақырып.

Енді дипфейктерге қатысты.

Негізінде бұл заңмен тыйым салынған жалған ақпарат тарату болып табылады және о үшін әкімшілік, тіпті қылмыстық жауапкершілік қарастырылған. Бірақ егер дипфейк тікелей көрсетілсе, мысалы, бұл ИЖИ көмегімен жасалған коллаж екені, немесе сатиралық сурет және т.б. көрсетілсе – пайдаланушыларға бұл олардың алданып жатқаны, бұл нақты фото немесе видео емес екені толық түсінікті болған кезде – жалған ақпарат таратқаны үшін жауапкершілік туындамауы керек.Сондықтан, осындай жағдайларда, соның ішінде ИЖИ қолданылған жағдайда да, жоғарыда көрсетілген жалпы ережелер мен ерекшеліктерді басшылыққа алып, жалған ақпарат таратпау керек.

Нұсқаулық: кибер алаяқтардың құрбаны болмаңыз

Сарапшылармен әңгімелесуден алынған басты қорытынды – үрей тудырады: көз бен құлақ енді сенімді куәгер емес. Егер смартфон экранында анаңыздың бетін көрсеңіз немесе бастығыңыздың дауысын естісеңіз – бұл тек 30 минутта жасалуы мүмкін пикселдер мен жиіліктер жиынтығы ғана. Өзіңізді қорғау үшін «құрбан» рөлінен «белсенді тарап» рөліне ауысу керек. Міне, қадамдық алгоритм:

1. «Қарсы шабуыл» ережесі: бастаманы өз қолыңызға алыңыз

Егер сізге қоңырау шалса (мессенджерде немесе телефон арқылы) және ақша сұраса, апат туралы қорқытса немесе «құпия инвестициялар» ұсынса:

2. «Цифрлық уақыт тапшылығын» бұғаттау

Алаяқтар әрқашан уақыт тапшылығын тудырады («қазір қажет!», «шот бес минуттан кейін бұғатталады»).

10 минуттық үзіліс жасаңыз. Телефонды қойып, су ішіңіз. Осы уақыт ішінде эмоционалды жағдай қалыпқа келеді және сіз жағдайды салмақты бағалай аласыз.

Есте сақтаңыз: ешбір ресми орган бес минут ішінде телефон арқылы шешуші мәселелерді шешпейді.

3. Сілтемелер мен «цифрлық іздердің» гигиенасы

4. БАҚ пен брендтерге арналған параноидальды сүзгі

Tengrinews.kz парақшасындағы төлемдер туралы жаңалықты көрдіңіз бе – браузердегі мекенжайды тексеріңіз. Егер онда tengri-news.com немесе tengrinews.kz.web.ru деп жазылса – бұл фишинг. Нақты мекенжай тек біреу: [tengrinews.kz](https://tengrinews.kz/).

«Көздеріңізге сенбеңіз». Қорытынды

Өткен ғасырда Козьма Прутковтың сыни ойлауға шақыратын танымал афоризмі болған:

«Егер тордағы пілдің үстінен «буйвол» деп жазылған жазуды оқысаңыз – көзіңізге сенбеңіз».2026 жылы бұл сөз енді жұмыс істемейді. Тордағы пілдің «піл» деген жазуымен бірге тұрғаны оның шынымен піл екеніне кепілдік бермейді. Қызық болса, Козьма Прутковтың өзі де кейіннен ойдан шығарылған кейіпкер болып шықты: бұл псевдонимнің астында бір топ әдебиетшілер жасырынған.

Бейнелер мен фотосуреттер енді шындықтың дәлелі емес – енді бұл «ойын алаңы» және өнер саласы. Бұл алаңдатады: неге сүйенуге болатыны, факт ретінде не қабылдауға болатыны белгісіз болып қалады.

Болашақта кез келген әрекет үшін көп сатылы тексеруден өтуге тура келе ме? Ақпарат министрлігі пайда болады ма? Немесе біз, өткен ғасырлардағыдай, тек тірі куәгерлерге сенеміз бе?

Бұл да шек емес: келесі кезең – мүмкін, алаяқтық голограммалар. Онда сенімділік үшін тек көру емес, ұстау да қажет болады. Ең болмағанда, тактильді дипфейктер пайда болмайынша.

Бұл ең жақын болашақ емес деп сенгіміз келеді.

Ал әзірге қарапайым ережелер қалады: